文書の過去の版を表示しています。

Semantic Segmentation

視覚障害支援用途の領域分割アノテーションを実施して、認識モデルに持っていくまでの馬場の忘備録。論文執筆用に引用などもメモしていきます。

令和5年3月15日現在、5000枚程度の画像アノテーションを済ませており、このvidvipデータセットを使い、推論用のモデル生成までの流れを以下にまとめます。

vidvip segmentationデータセット

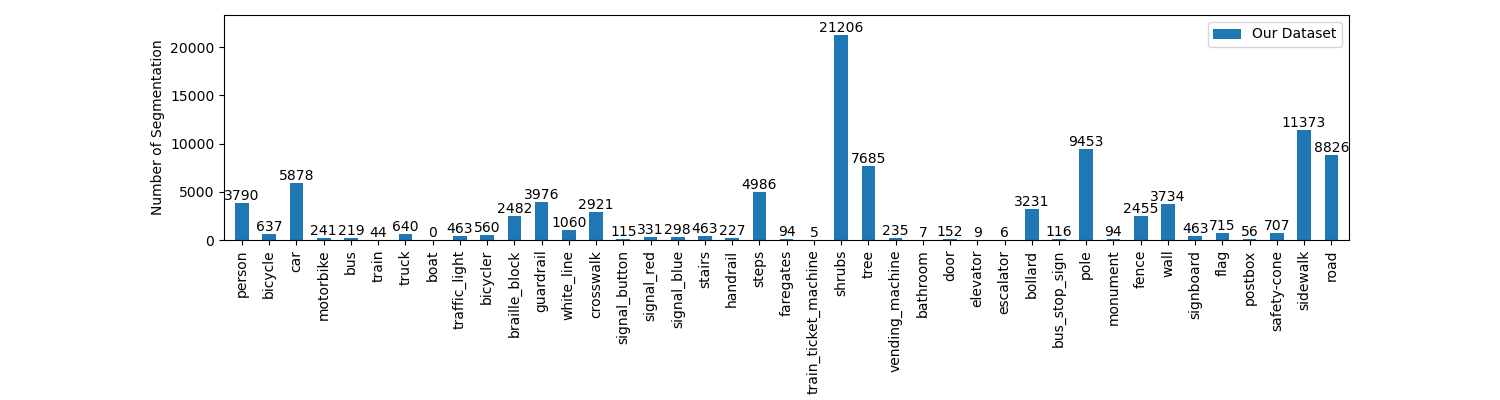

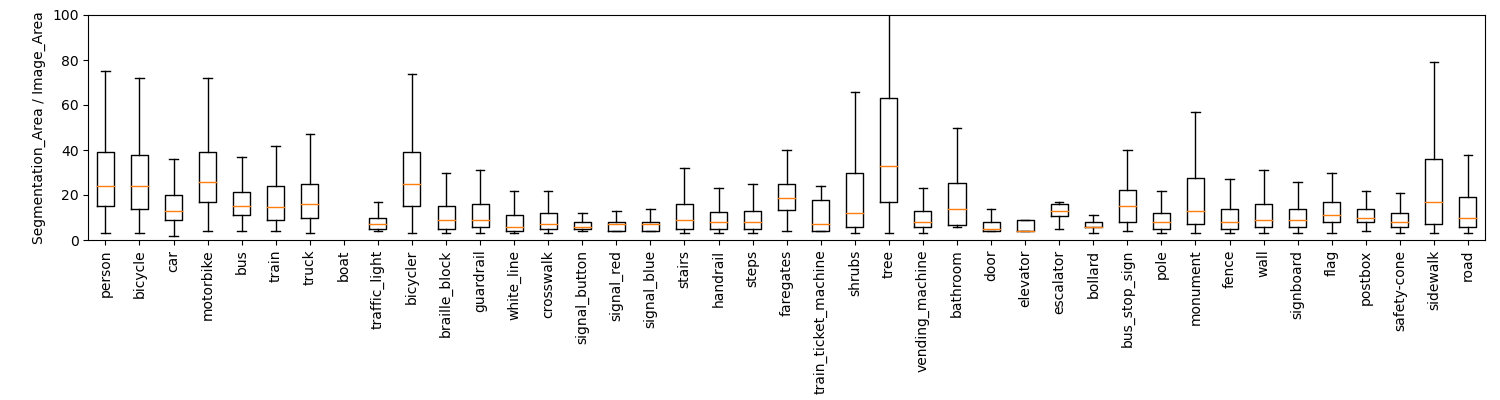

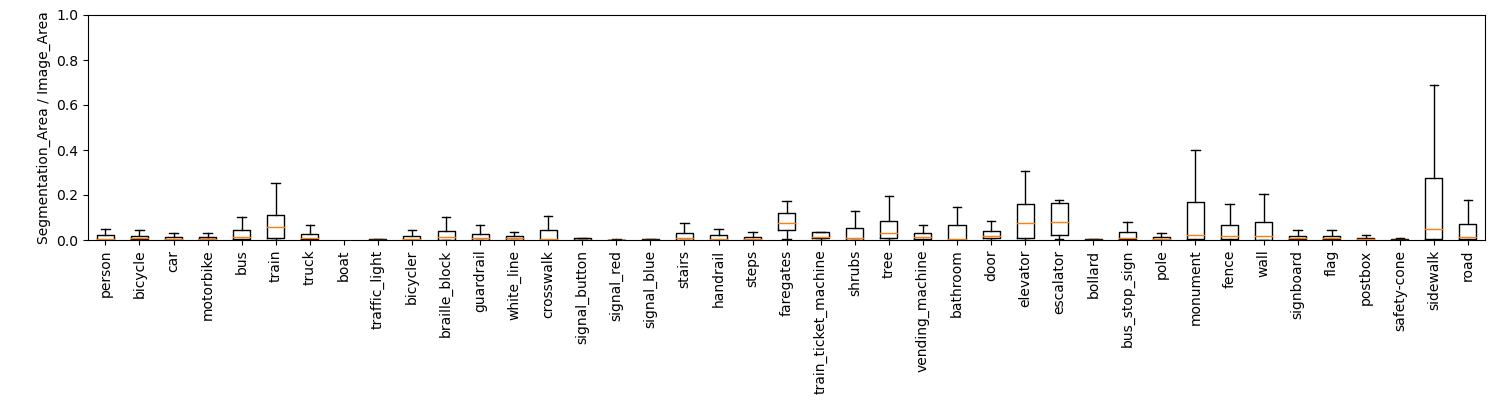

vidvipでは令和5年3月15日現在で、5698枚の画像に対して、99953箇所のセグメンテーションによるアノテーションが作成されています。この画像セットはvidvip object detectionと同様の画像セットや一部都立大中庭を利用したデータセットになっており、アノテーションの種類に偏りがあるunbalancedなデータセットです。本データセットの詳細は以下の通り。上から順にアノテーション数、各ラベルの登録頂点数に関する箱ひげ図、各ラベルの登録面積[pixel^2]に関数もの。

参考文献

-

- 論文にたいなドキュメンテーションがあってそれがすごい参考になる

- いろいろ参考になるので論文からデータまでなめるように見ておく。ラベル数は12(vehicle, pedestrian, road, sidewalk, bicycle, motorcycle, building, terrian (horizontal vegetation), vegetation (verti- cal vegetation), pole, traffic light, traffic sign)

- 最初は少人数グループでアノテーション作業を行い、1.5時間/画像 というとんでもない作業

- アノテーション作業にはlabelmeを利用している